Modus penipuan baru, pakai AI untuk galang sumbangan korban gempa

Februari 16, 2023 § Tinggalkan komentar

Gempa di Turki dan Suriah menginspirasi para penipu.

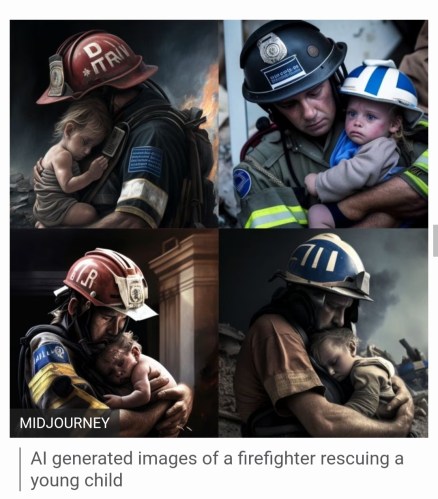

Laman berita BBC melaporkan para penjahat digital memanfaatkan teknologi AI untuk menghasilkan foto-foto palsu yang menyentuh demi meraup sumbangan dari para donatur untuk korban gempa.

Orang jahat, para penipu, scammers selalu punya cara untuk melancarkan aksi kriminalnya, dengan atau tanpa bantuan teknologi AI. NFT dan crypto pun tak luput dari tangan jahat para scammers.

Untuk menangkal praktik penipuan semacam ini, menurut ChatGPT, ada beberapa tindakan yang dapat dilakukan:

Waspadai dan jangan terburu-buru memberikan informasi pribadi: Hindari memberikan informasi pribadi atau mengklik tautan dari orang yang tidak dikenal. Pastikan untuk memverifikasi keaslian sumber informasi sebelum memberikan informasi apa pun.

Gunakan sumber informasi yang terpercaya: Periksa berita dari sumber informasi yang terpercaya, seperti lembaga pemerintah atau organisasi bantuan yang sudah terverifikasi. Hindari mengikuti tautan atau informasi yang mencurigakan atau tidak terverifikasi.

Jangan memberikan donasi tanpa melakukan pengecekan terlebih dahulu: Pastikan untuk melakukan pengecekan terlebih dahulu sebelum memberikan donasi. Ada banyak organisasi yang bisa dipercaya dan menerima donasi untuk membantu para korban bencana. Pastikan bahwa organisasi tersebut resmi dan terverifikasi.

Verifikasi gambar dan video: Verifikasi keaslian gambar dan video yang Anda terima sebelum menyebarluaskannya ke media sosial. Ada banyak alat dan sumber daya online yang dapat membantu Anda memverifikasi gambar dan video seperti perangkat lunak reverse image search dan sumber-sumber berita terpercaya.

Laporkan aktivitas penipuan: Jika Anda menerima pesan atau melihat aktivitas penipuan yang mencurigakan, laporkan aktivitas tersebut kepada lembaga penegak hukum atau badan regulasi yang berwenang. Hal ini akan membantu mengurangi penipuan dan melindungi para korban bencana.

Dengan memperhatikan hal-hal di atas, Anda dapat membantu mencegah penipuan yang menggunakan gambar-gambar AI dan melindungi diri Anda sendiri dan orang lain dari kerugian akibat penipuan.

Bagaimana menghadapi penipuan yang menggunakan foto karya AI?

Penipuan menggunakan foto karya AI atau yang dikenal dengan istilah “deepfake” dapat menjadi masalah yang sangat sulit untuk diatasi. Namun, ada beberapa tindakan yang dapat diambil untuk menghadapi penipuan semacam ini:

Waspadai dan periksa keaslian sumber foto: Sebelum mengambil tindakan apa pun, pastikan untuk memeriksa sumber foto tersebut. Jika Anda merasa ada sesuatu yang tidak benar, seperti adanya perbedaan dalam format atau kualitas gambar, cek kesahihan foto di sumber aslinya.

Periksa kesalahan kecil dalam gambar: Meskipun foto deepfake sangat sulit untuk dibedakan dari foto asli, ada beberapa kesalahan kecil yang mungkin bisa ditemukan pada gambar seperti lip-sync yang tidak cocok, rambut atau bayangan yang tidak benar.

Gunakan teknologi pemantauan: Ada beberapa teknologi yang dapat membantu Anda memantau dan mendeteksi deepfake seperti perangkat lunak pendeteksi deepfake dan layanan konsultasi keamanan cyber.

Konsultasikan dengan ahli: Jika Anda merasa tidak yakin tentang keaslian suatu foto, konsultasikan dengan ahli keamanan cyber atau ahli hukum yang memiliki pengalaman dalam menangani kasus-kasus penipuan.

Laporkan: Jika Anda yakin bahwa suatu foto adalah deepfake dan sedang digunakan untuk tujuan penipuan, laporkan kejadian tersebut ke lembaga penegak hukum yang berwenang untuk tindakan lebih lanjut.

Perkuat keamanan data: Terakhir, pastikan untuk memperkuat keamanan data pribadi Anda dengan menghindari berbagi informasi sensitif secara terbuka dan menghindari tautan atau file yang mencurigakan.

Bagaimana mengenali ciri deepfake?

Deepfake adalah jenis manipulasi media digital yang dapat sulit dideteksi. Namun, ada beberapa ciri khas yang dapat membantu Anda mengenali deepfake:

Gerakan yang tidak wajar: Salah satu tanda deepfake adalah gerakan yang tidak wajar pada gambar. Hal ini mungkin tampak seperti gerakan yang canggung atau kurang alami. Ini mungkin terlihat pada mata, bibir, atau bahkan kepala yang terlihat tidak seimbang dengan tubuh.

Suara yang tidak sinkron: Deepfake juga dapat berisi suara yang tidak sinkron dengan gerakan bibir. Ini mungkin terdengar seperti celah kecil antara kata-kata, atau suara yang tidak terdengar seperti suara yang seharusnya keluar dari mulut orang yang tampil pada gambar.

Kualitas gambar yang berbeda-beda: Deepfake sering kali memiliki kualitas gambar yang berbeda-beda, karena gambar-gambar tersebut dibuat dari beberapa sumber yang berbeda. Mungkin ada perbedaan dalam kualitas warna atau tingkat kecerahan gambar.

Kedalaman gambar yang tidak sesuai: Deepfake juga dapat memiliki masalah dengan kedalaman gambar. Ini mungkin terlihat seperti bayangan objek yang tidak sesuai dengan lingkungan di sekitarnya.

Kesalahan dalam konteks: Deepfake mungkin memiliki kesalahan dalam konteks atau skenario, seperti seorang politisi yang mengucapkan sesuatu yang tidak masuk akal atau kelakuan yang tidak sesuai dengan kebiasaan orang tersebut.

Kualitas gambar yang terlalu baik: Deepfake sering kali menggunakan teknologi AI canggih untuk membuat gambar yang terlihat sangat realistis. Namun, gambar yang terlalu sempurna bisa menjadi ciri yang mencurigakan karena orang pada gambar terlihat terlalu mulus dan tidak memiliki kecacatan atau cela seperti orang pada umumnya.

Perlu diingat bahwa deepfake sangat sulit untuk dideteksi, jadi ada kemungkinan deepfake yang tidak memperlihatkan semua tanda-tanda ini.

Jika Anda merasa curiga atau ragu tentang keaslian suatu gambar atau video, pastikan untuk memeriksa kebenaran sumber aslinya.

Selamat Hari Kamis, Kisanak!

Tinggalkan komentar